Geleneksel İşlemcilerin Yapay Zeka Sınırları

Geleneksel işlemciler (CPU ve GPU), yıllardır yapay zeka (AI) işlemlerini yürütüyor olsa da, bu görevler için optimal olarak tasarlanmamışlardır. Özellikle makine öğrenimi modellerinin yoğun matris çarpımı ve toplama işlemleri, CPU’lar için enerji israfına ve düşük verimliliğe yol açar. Bu nedenle donanım sektörü, AI iş yüklerini çok daha verimli bir şekilde yürütebilen amaca özel çiplere yönelmiştir. Yeni AI çipleri, daha düşük gecikme süresi ve daha az güç tüketimi ile AI’ın yaygınlaşmasının anahtarıdır.

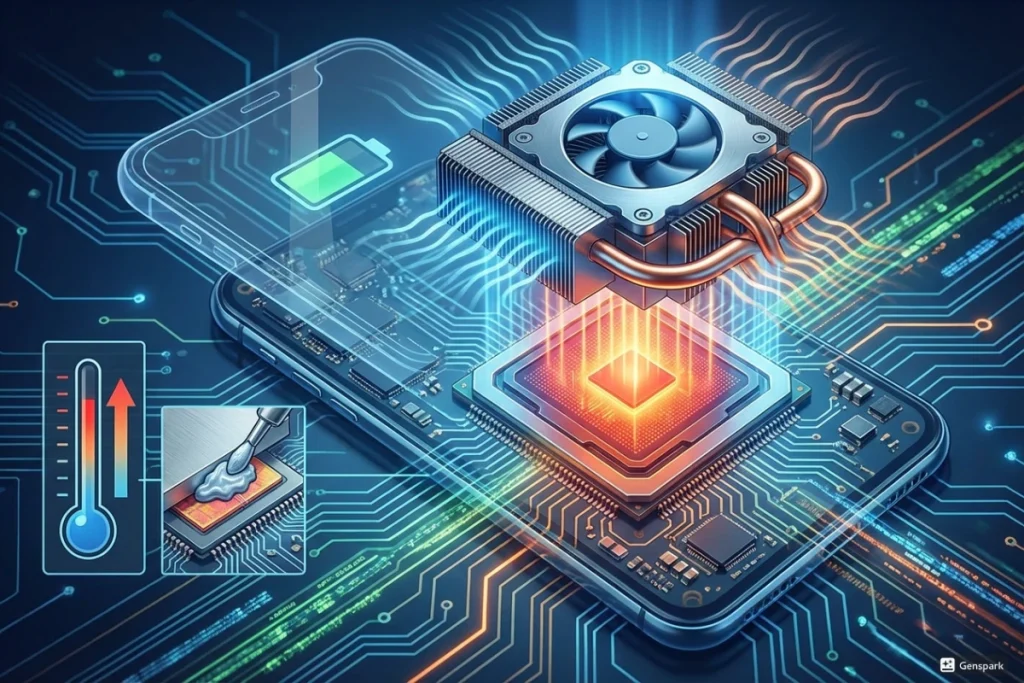

Nöral İşlem Birimleri (NPU) Nedir?

Nöral İşlem Birimleri (NPU) veya Nöral Motorlar, doğrudan makine öğrenimi algoritmalarının temelini oluşturan matematiksel işlemleri hızlandırmak için tasarlanmış özel donanım bileşenleridir. Akıllı telefonlardan dizüstü bilgisayarlara kadar yaygınlaşan NPU’lar, yüz tanıma, doğal dil işleme ve kamera efektleri gibi AI görevlerini CPU veya GPU’ya göre kat kat hızlı ve enerji verimli yapar. NPU’lar, özellikle çıkarım (inference) aşamasında mükemmel bir performans sergileyerek, AI işlemlerinin yerel cihazlarda çalıştırılmasına olanak tanır.

Özel AI Hızlandırıcılar (TPU, ASIC)

Veri merkezleri ve büyük bulut platformları için, Google’ın Tensör İşlem Birimi (TPU) gibi Uygulamaya Özel Tümleşik Devreler (ASIC) hayati öneme sahiptir. TPU’lar, özellikle büyük makine öğrenimi modellerinin eğitimi için optimize edilmiştir. Bu özel donanımlar, binlerce çekirdeği bir araya getirerek büyük veri kümeleri üzerinde paralel hesaplamaları inanılmaz bir hızla gerçekleştirir. ASIC’ler, genel amaçlı GPU’lara kıyasla watt başına çok daha yüksek performans sunar, bu da büyük ölçekli AI operasyonlarının maliyetini ve çevresel etkisini azaltır.

Heterojen Hesaplama ve Entegrasyon

Geleceğin donanım mimarisi, artık tek bir güçlü işlemciye değil, farklı görevler için optimize edilmiş birçok bileşenin (CPU, GPU, NPU, DSP) birlikte çalıştığı heterojen hesaplamaya dayanmaktadır. Yeni nesil yongalar, bu farklı işlem birimlerini tek bir pakette birleştirerek (System-on-Chip – SoC) verilerin bileşenler arasında hızla akmasını sağlar. Bu sıkı entegrasyon, sistemin genel verimliliğini artırırken, enerji tüketimini optimize eder. Donanım üreticileri, bu heterojen yapıları kullanarak her iş yüküne uygun en verimli çözümü sunmayı amaçlamaktadır.

Kuantizasyon ve Düşük Hassasiyetli Hesaplama

AI çipleri, verimliliği artırmak için kuantizasyon (nicemleme) adı verilen bir teknik kullanır. Bu teknik, modellerdeki sayıları 32-bit veya 16-bit float yerine 8-bit veya 4-bit tam sayılara dönüştürerek bellek ve hesaplama gereksinimlerini önemli ölçüde azaltır. Nöral motorlar, bu düşük hassasiyetli hesaplamaları gerçekleştirmek için özel olarak tasarlanmıştır ve modelin doğruluğundan büyük ölçüde ödün vermez. Bu optimizasyon, AI modellerinin mobil cihazlarda ve uç bilişimde (Edge Computing) daha hızlı ve daha az güçle çalışmasını sağlar.

Yazılım Araçları ve Ekosistemlerin Rolü

AI çip teknolojisinin benimsenmesi, sadece donanıma bağlı değildir. Geliştiricilerin, TensorFlow ve PyTorch gibi popüler çerçeveleri yeni NPU’lar üzerinde sorunsuz bir şekilde çalıştırabilmeleri için güçlü yazılım araçlarına ve ekosistemlere ihtiyaç vardır. Çip üreticileri, geliştirdikleri özel donanımlar için optimize edilmiş yazılım geliştirme kitleri (SDK) ve derleyici araç zincirleri sunmak zorundadır. Bu yazılım desteği, donanımın gerçek potansiyelini ortaya çıkarmanın ve geniş bir geliştirici kitlesine ulaşmanın kritik ön koşuludur.

Sonuç

AI çipleri ve Nöral Motorlar, bilgi işlem dünyasında yeni bir verimlilik çağı başlatmaktadır. Geleneksel işlemcilerin yerini alan NPU ve ASIC’ler, büyük dil modellerinin eğitimi ve çıkarımı için gerekli hızı ve enerji verimliliğini sağlamaktadır. Heterojen hesaplama ve kuantizasyon gibi tekniklerle desteklenen bu donanım devrimi, AI yeteneklerini veri merkezlerinden mobil cihazlara kadar yayarak, teknolojinin her yerde hazır ve daha verimli olmasını garanti altına almaktadır.

Sık Sorulan Sorular

Nöral Motor (NPU) ne işe yarar?

Nöral Motor, makine öğrenimi algoritmalarını (özellikle çıkarım aşamasında) CPU ve GPU’dan çok daha hızlı ve enerji verimli bir şekilde yürütmek için tasarlanmış özel bir işlem birimidir.

TPU ve GPU arasındaki fark nedir?

GPU genel amaçlı paralel hesaplamalar için tasarlanmıştır. TPU ise Google tarafından özellikle tensör işlemleri (matris çarpımı) için tasarlanmış, AI eğitimi konusunda GPU’lardan daha verimli bir ASIC’tir.

Heterojen hesaplama nedir?

Farklı işlem birimlerinin (CPU, GPU, NPU) tek bir sistemde veya yongada bir araya gelerek her görevi en uygun donanımda çalıştırması prensibidir.

Kuantizasyon (Nicemleme) neden önemlidir?

Kuantizasyon, AI modellerindeki sayıların hassasiyetini düşürerek modelin boyutunu ve hesaplama gereksinimini azaltır. Bu, özellikle uç bilişim cihazlarında AI’ı hızlandırır.

NPU’lar sadece mobil cihazlarda mı var?

Başlangıçta mobil cihazlarda yaygınlaşsa da, günümüzde NPU’lar ve Nöral Motorlar, Intel ve AMD gibi üreticilerin yeni nesil dizüstü ve masaüstü işlemcilerine de entegre edilmektedir.